投稿日 : 2019.12.31

革新!? 冒涜!? 開発担当者に聞いた「AI 美空ひばり」の仕組み

MENU

2019年の大晦日、昭和の大スター・美空ひばり(1989年死去)が数十年ぶりにNHK紅白歌合戦のステージに帰ってきた。披露されたのは新曲「あれから」。故人が歌えるはずもない「新曲」の歌唱を、どのようにして実現したのか?

このプロジェクトを担当したヤマハの開発者、大道竜之介氏と才野慶二郎氏に話を聞いた。

AI に歌を聴かせ、何度も歌わせる

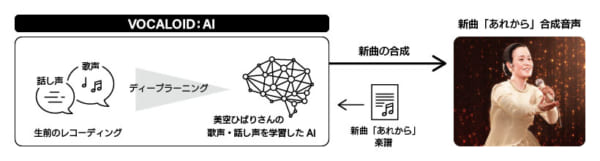

今回の AI 歌唱を可能にしたのは、ヤマハが開発した新しい歌声合成技術『VOCALOID:AI(ボーカロイド:エーアイ)』。人工知能「AI」を用いたこの技術は、美空ひばりの過去の録音や楽譜をはじめ、彼女の歌い方やクセに至るまで、膨大なデータとして蓄積し、学習させていくことができる。

つまりあの新曲は、美空ひばりの「既存の歌唱音声」をもとに、AI が彼女の歌唱法を細部まで学習し、新たな楽譜や歌詞に沿って歌っていたというわけだ。

※上記の映像はこのページから再生することはできません。一度動画をクリックいただき、「この動画はYouTubeでご覧ください。」の部分を再度クリックすることで、YouTube公式サイトからご覧いただけます。

ちなみに、“ボカロ” の愛称で知られる『VOCALOID』(注1)も同社の開発だが、今回の『VOCALOID:AI』とは、似て非なるもの。仕組みがまるで違うのだという。

注1:ヤマハが開発した歌声合成技術。録音した人間の声を楽譜や歌詞に割り当て歌わせることのできる技術。

従来の『VOCALOID』は、人間の声から抽出した、短いパーツの「音素(素材となる音)」を、歌詞やメロディーに合わせて滑らかにつなぎ合わせるという手法が取られる。

一方、 今回の『VOCALOID:AI』は、ディープラーニング(注2)という新しい技術により、AI 自体に歌を聴かせ、何度も歌わせることで、対象となる人物の歌い方や声の特徴を学習させていく。

注2:コンピューター自体に課題の解決方法を学習させる機械学習法のひとつ。

美空ひばり“らしさ”はどこから生まれる?

いわば、AI に歌唱を「体得」させて、歌手として自立させるイメージだ。一体どんなプロセスを経て「完成」に至るのだろうか。

「(AI は)最初はまったく似ていない声でデタラメに歌うのですが、本物のひばりさんに近づくように、声の出し方や歌い方を変えるという作業を、自動的に繰り返していきます。この手順を何万回、何十万回と繰り返すことで、楽譜の文脈に応じた “ひばりさんの声色や歌い方” をマスターした AI が完成します。そこに新曲の楽譜を与えれば、たとえ歌ったことがない曲でも、ひばりさんの声色と歌い方で歌うことができるわけです」

もちろん、そう簡単に「AI 美空ひばり」を完成できるわけではない。

「ひばりさんの見事な歌声は、さまざまな要素が絶妙に絡み合うことで成り立っています。言葉の聞こえ方、声の鳴り出し、切れ際のニュアンス、そういう細部のすべてを再現できる AI に仕上げていく必要がありました」

この作業は、開発者サイドをもっとも苦しめた要因のひとつだったという。楽譜に忠実なだけでは、人間味や温かみを再現することは難しく、わずかな音程の揺らぎやタイミングのズレなども学習させる必要があったようだ。

「ご本人の歌声と『VOCALOID:AI』の歌声、さまざまな要素を丹念に調べながら、AI の構成や学習方法を工夫し、少しずつ精度を高めていったんです」

このプロジェクトでもっとも気を使ったのは、美空ひばりの「純度」だったとか。これを保つため、AI が学習した歌声に対して人間の手を必要以上に加えることはなかったという。

一方で、企画の意図や時代感といった、楽譜からは汲み取ることのできない “プロデューサーの想い” を AI に伝えることも必要。そこで、美空ひばりの過去のステージや時代ごとの様々な歌い方の中から、「今回はどのような歌い方を望むのか」という意図を AI にリクエストできる仕組みも組み込まれていたという。

故人を再現するうえで一番大切なこと

プロジェクトの始動から約1年を経て、ついに完成した「AI 美空ひばり」の歌声。亡くなった昭和の大スターの新曲を聴けるという、夢のような話が実現したのだ。

こうした AI を活用した技術は、亡くなった歌手だけでなく、例えばジャズやクラシックの楽器演奏者にも応用できる可能性もある。実際にヤマハでは、今年9月にグレン・グールドのピアノ演奏を学習し、コンサートを披露するという AI プロジェクトを実施している。

そうなると、今後も “蘇る偉人” にますます期待が高まる。しかし「技術的に可能であっても、軽はずみに行うべきことではない」と両氏は語る。

「ひばりさんのプロジェクトにしても、グレン・グールドにしても、故人と関係が深かった方々の理解と情熱があり、さらに関係者全員に、故人の音楽と真剣に向き合う姿勢があったからこそ成立しています。その点は決して忘れてはいけないものだと考えています」

こうした技術は一歩間違えれば故人への冒涜にもなりかねない。亡くなった人を扱うということは、その本人だけでなく遺族や関係者たちの十分な理解と配慮が必要なのだ。こうした点を踏まえながら、ヤマハは「AI と人間の共創」の可能性を模索し続けている。

同社はこれまでに、人間と合奏できる「人工知能合奏技術」や、ダンスでピアノを演奏できる「ダンス認識ピアノ演奏システム」を用いたプロジェクトなども展開。

「人間の表現をサポートしたり、ときに互いを刺激し合うことで新しい表現を生みだしていける。そんな AI と人間の関係性を、これからも追求していきたいと考えています」